Google anunció recientemente una serie de actualizaciones de su modelo Gemini AI, incluidas varias actualizaciones y nuevos modelos. Entre ellos, uno que llamó mucho la atención fue Gemini Live, un modelo de IA multimodal que presenta capacidades de video y voz.

Desde que Bard pasó a llamarse Gemini en febrero, el modelo de IA ha servido como reemplazo del Asistente de Google en dispositivos Android. Sin embargo, lo que puede hacer actualmente es bastante limitado. Con Gemini Live, Google pretende cambiar esto ofreciendo un modelo de IA más potente y versátil.

¿Qué es Géminis en Vivo?

Para brindar a los usuarios una experiencia de IA mejorada y enfrentarse al ChatGPT mejorado GPT-4o de OpenAI, Google anunció recientemente Gemini Live en su Conferencia de desarrolladores de E/S. Gemini Live permitirá a los usuarios mantener conversaciones naturales y personalizadas en tiempo real con él a través de voz y, posteriormente, vídeo.

El nuevo modelo de IA es parte del Proyecto Astra de Google, que es el intento del gigante de las búsquedas de construir un asistente de IA universal que pueda utilizar diferentes tipos de entradas de la vida cotidiana para brindar asistencia. Por ejemplo, Gemini Live puede usar texto, imágenes de la cámara de su teléfono inteligente y su voz para responder preguntas.

Según Google, el nuevo modelo de lenguaje natural no sólo ayudará a los usuarios a resolver problemas y realizar diversas acciones, sino que también se sentirá completamente natural durante las interacciones. Los usuarios podrán iniciar Gemini Live tocando el ícono de voz en su teléfono, que mostrará la IA en pantalla completa con un efecto de forma de onda de audio.

Luego podrás conversar con la IA tal como lo harías con un asistente personal real. Un excelente ejemplo de cómo el modelo de IA actualizado puede ayudarle es cuando le pide ayuda con la preparación de una entrevista. Gemini Live sugerirá las habilidades que puede resaltar, brindará consejos para hablar en público y más.

Características

Gemini Live viene con algunas características que lo convierten en un asistente de inteligencia artificial mucho mejor que el Asistente de Google, Siri de Apple o Alexa de Amazon.

Conversaciones de voz bidireccionales

Gemini Live te permite conversar con él y proporciona respuestas verbales similares a las humanas, lo que da como resultado conversaciones interesantes e intuitivas. Por ejemplo, puedes preguntarle sobre el tiempo y te dará una actualización precisa y concisa.

Capacidades de asistente inteligente

El modelo de IA puede servir como asistente inteligente y realizar tareas como resumir información de correos electrónicos y actualizar su calendario. Por ejemplo, puedes tomar una foto del folleto de un concierto y Gemini agregará el evento a tu calendario.

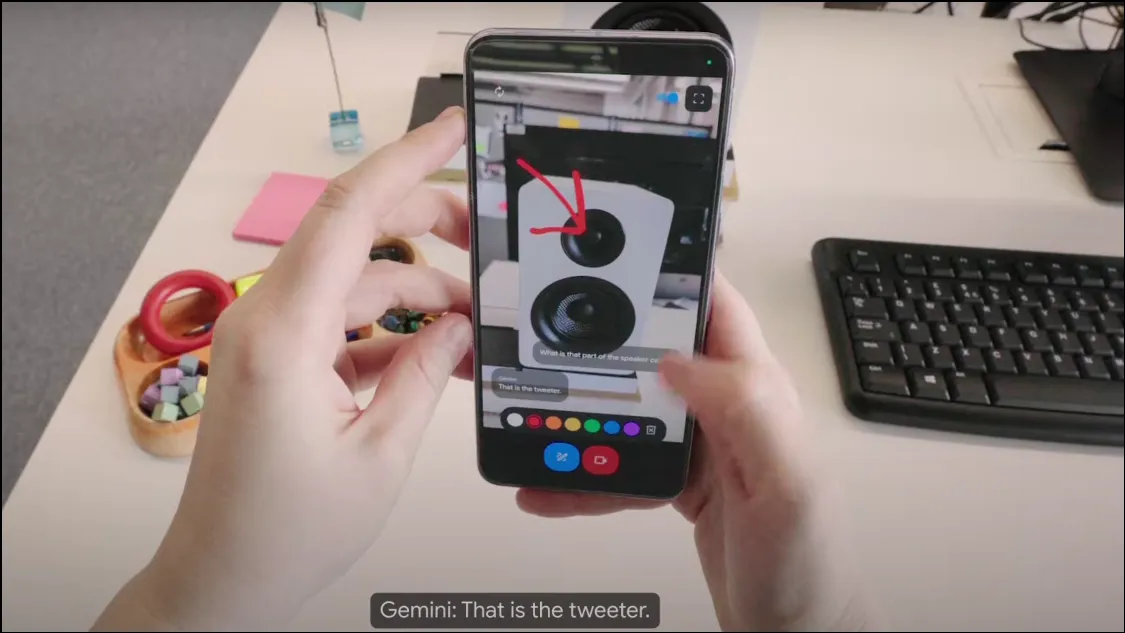

Capacidades visuales

Al usar la cámara de su teléfono inteligente, Gemini Live puede capturar videos en tiempo real. Esto le permite identificar objetos y responder preguntas sobre ellos. Por ejemplo, si apuntas la cámara de tu teléfono inteligente a un altavoz y le pides a Gemini que lo identifique, te dirá qué es e incluso identificará su marca y modelo.

¿Cómo funciona Gemini Live?

El Proyecto Astra puede combinar entradas visuales y de voz, haciéndolas fáciles de entender para el modelo de IA. Luego puede reaccionar a la información y proporcionar la asistencia necesaria. Al igual que ChatGPT con tecnología GPT-4o de OpenAI, Gemini Live es una IA multimodal y no depende únicamente del texto como entrada.

Si bien Gemini Live utilizará originalmente la entrada de voz para recopilar y analizar datos en el lanzamiento inicial, se actualizará en los próximos meses para procesar y analizar también videos dividiéndolos cuadro por cuadro para una mejor comprensión e interacción.

La IA puede adaptarse a la velocidad a la que hablan los diferentes usuarios, e incluso puedes interrumpirla para pedir aclaraciones o aportar más información. Su capacidad para imitar el diálogo humano puede proporcionar una interacción más atractiva. Por lo tanto, puedes mantener una conversación con él, como con un asistente humano. Además, podrás elegir entre diez voces diferentes para la IA.

GPT-4o vs. Géminis en vivo

Si bien tanto GPT-4o como Gemini Live son modelos de IA multimodal, en este momento es difícil ver cuál funciona mejor en la vida real, especialmente porque ninguno está disponible públicamente en este momento.

Sin embargo, a diferencia de ChatGPT, Gemini Live se basa en otros modelos de inteligencia artificial como Google Veo e Imagen 3 para proporcionar resultados en forma de videos e imágenes. A pesar de eso, en las demostraciones mostradas por OpenAI y Google, ChatGPT parecía más natural y el nuevo modelo GPT-4o podía incluso detectar y simular emociones humanas a través de tonos vocales.

Además, puede adaptarse a la forma en que quieras que responda, lo que Gemini Live no puede hacer, al menos en su estado actual.

Disponibilidad en vivo de Géminis

Gemini Live estará disponible para los suscriptores de Gemini Advanced, que es la versión paga del chatbot de IA. Se implementará en los próximos meses y se espera que esté ampliamente disponible a finales de año.

Aplicaciones como Google Messages podrán aprovechar al máximo Gemini Live, permitiendo a los usuarios interactuar con la IA directamente dentro de la aplicación de mensajería.

Gemini Live podría ser la próxima actualización importante del chatbot de inteligencia artificial de Google, y justo lo que necesita para enfrentarse a rivales como ChatGPT de OpenAI. Con funcionalidad multimodal y potentes capacidades de voz, el modelo actualizado puede ayudar a Google a lograr el éxito al ofrecer un asistente digital versátil y confiable.

Por el momento, Google sólo ha anunciado que llevará el nuevo modelo de IA a los suscriptores pagos. Si bien esto deja fuera a los usuarios gratuitos, que constituyen una gran parte de la base de usuarios de Google, esperamos que Google cambie su postura y decida ampliar la disponibilidad de Gemini Live.

Deja una respuesta